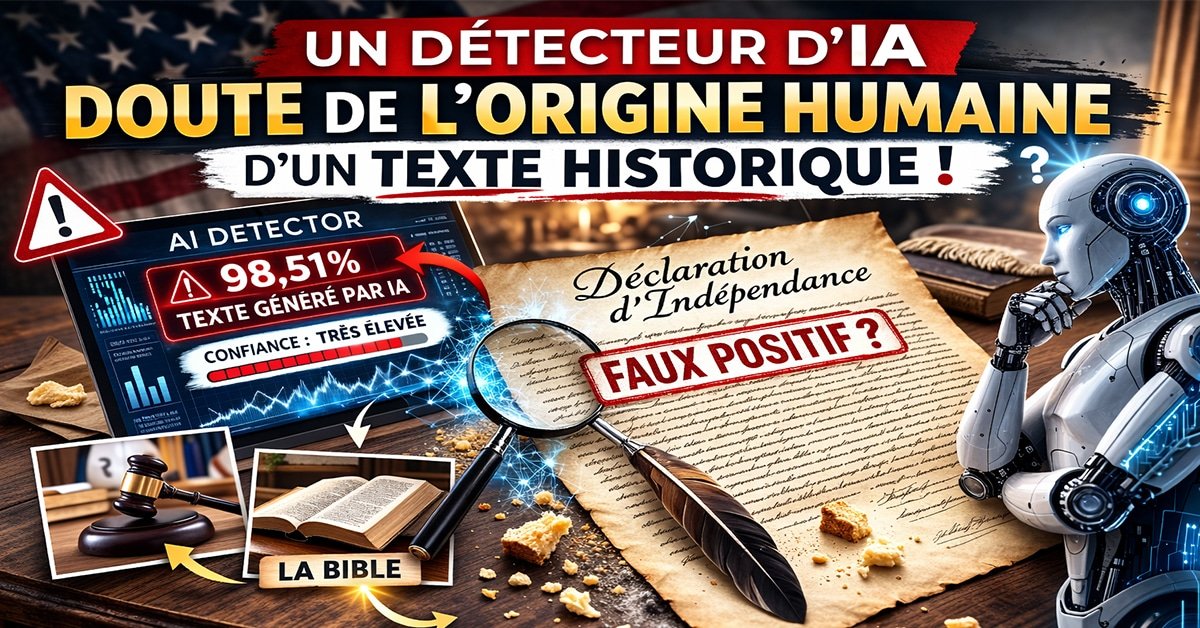

Lorsqu’un outil de détection d’intelligence artificielle a classé la Déclaration d’indépendance des États-Unis comme étant « rédigée à 98,51 % par une IA », il n’a évidemment pas réécrit l’histoire. Mais il a sérieusement ébranlé nos certitudes actuelles sur la manière dont nous décidons quoi — et qui — croire en ligne.

Un texte fondateur étiqueté comme “faux”

La Déclaration d’indépendance, signée le 4 juillet 1776, est considérée comme l’un des piliers de la démocratie moderne. Elle officialisait la rupture des colonies américaines avec la Couronne britannique et affirmait une vision radicale des droits individuels.

Pourtant, un outil moderne censé détecter les textes générés par des modèles d’intelligence artificielle lui a attribué un score la présentant comme presque entièrement produite par une machine.

L’absurdité saute aux yeux : aucun modèle de langage n’existait au XVIIIe siècle. Les systèmes comme ChatGPT sont apparus près de deux siècles et demi plus tard.

Ce résultat, aussi spectaculaire qu’infondé, est devenu un cas d’école des limites actuelles des détecteurs d’IA.

Le test a été relayé par la spécialiste SEO Dianna Mason, qui analyse la fiabilité des outils de détection lorsqu’ils sont confrontés à des textes historiques et juridiques. Et la Déclaration n’était pas la seule victime.

Quand la Bible “échoue” au test d’IA

D’autres essais ont montré que des décisions de justice des années 1990, voire des passages de la Bible, étaient également classés comme « probablement générés par une IA ».

Ces textes précèdent pourtant l’IA générative de plusieurs décennies, voire de plusieurs siècles.

- → Trois actions canadiennes à considérer avec un investissement de 7000 $ dans un CELI en 2026

- → L’Ontario élargit le remboursement de la TVH : une mesure clé pour relancer le marché immobilier en 2026

- → L’Ontario élargit le remboursement de la TVH en 2026 : un coup de pouce majeur pour les acheteurs de logements neufs

- → Retraite au Canada : combien accumuler dans un CELI pour vivre confortablement

- → Le Canada face à un risque de récession prolongée : ce que l’avertissement de la Banque du Canada signifie pour vos finances

- → Sécurité de la vieillesse au Canada : un programme à 85,5 milliards au cœur du budget fédéral

Ces faux positifs ne sont pas de simples curiosités amusantes. Ils soulèvent des questions sérieuses sur l’usage de ces outils dans les écoles, universités, médias et entreprises, où ils peuvent influencer des décisions liées au plagiat, à la triche ou à l’authenticité.

Quand un détecteur affirme que la Bible ou un jugement historique est “écrit par une IA”, le problème ne vient pas du texte. Il vient du détecteur.

Une science fragile pour repérer les textes générés par machine

Les détecteurs d’IA fonctionnent principalement sur des statistiques. Ils analysent :

- la prévisibilité des mots,

- la fréquence de certains schémas linguistiques,

- la fluidité globale du texte,

- la régularité des phrases.

Or, de nombreux textes classiques ont été soigneusement rédigés, révisés et polis. Mathématiquement, ils peuvent sembler “trop propres”, “trop cohérents” — et donc ressembler à un texte généré par modèle.

Nous assistons à une sorte de course technologique permanente. À mesure que les modèles comme ChatGPT deviennent plus performants et plus naturels, les détecteurs tentent de s’adapter. Mais ils restent loin d’être infaillibles.

Contrairement à d’autres technologies utilisées dans des contextes sensibles, ces outils ne bénéficient pas toujours de validations scientifiques robustes avant leur déploiement.

Pourquoi les détecteurs se trompent

Plusieurs facteurs expliquent ces erreurs :

- Ils confondent parfois “texte de haute qualité” et “texte généré par machine”.

- Ils fonctionnent mal sur des textes courts, traduits ou fortement édités.

- Ils peinent face aux styles anciens ou spécialisés qui ne correspondent pas à leurs données d’entraînement.

- Ils peuvent être perturbés par les citations, la mise en forme ou les phrases récurrentes.

Dans certains cas, les outils attribuent un pourcentage très précis — par exemple 98,51 % — ce qui donne une illusion d’objectivité scientifique, alors que le modèle sous-jacent reste incertain.

Le risque pour les étudiants et les auteurs

Dans le monde académique, ces erreurs prennent une dimension préoccupante.

Un étudiant qui remet un devoir clair, structuré et bien rédigé peut être accusé d’avoir utilisé une IA simplement parce que son texte paraît “trop fluide”.

Les fausses accusations de triche deviennent une nouvelle source d’angoisse académique. Derrière des tableaux de bord élégants se cachent des outils bien plus faillibles qu’ils ne le laissent croire.

L’auteur importe-t-il vraiment au lecteur ?

Dianna Mason pose une question plus profonde : au-delà du “qui a écrit ?”, faut-il se demander si cela change réellement la manière dont nous devons évaluer un texte ?

Aujourd’hui encore, l’étiquette “généré par IA” porte une certaine stigmatisation. Beaucoup associent l’IA à un manque d’originalité, à des biais potentiels ou à une absence de “voix humaine”.

Mais les mentalités évoluent.

Les jeunes générations lisent quotidiennement des résumés automatiques, des réponses de chatbots et des légendes générées sans y prêter grande attention.

À mesure que l’IA s’intègre dans les emails, les moteurs de recherche, les logiciels professionnels et les réseaux sociaux, la frontière entre “humain pur” et “assisté par IA” devient floue.

Un journaliste peut brainstormer avec un chatbot.

Un avocat peut rédiger une première version avec une assistance numérique.

Un étudiant peut utiliser une IA pour structurer ses idées avant de réécrire intégralement.

À qui appartient alors le texte final ?

Quand l’origine du texte compte vraiment

Il existe néanmoins des domaines où l’attribution est cruciale :

- Santé : une information erronée générée automatiquement peut avoir des conséquences graves.

- Politique : la propagande automatisée peut être produite à grande échelle.

- Université : diplômes et certifications reposent sur l’apprentissage personnel.

- Création artistique : auteurs et traducteurs vivent de la reconnaissance de leur travail.

Dans ces contextes, la transparence et des politiques claires sont probablement plus utiles qu’un simple score de détection.

Que se passera-t-il si les détecteurs restent peu fiables ?

Si la détection reste imprécise alors que l’IA continue de progresser, les institutions pourraient se tourner vers d’autres solutions :

- filigranes intégrés dans les modèles d’IA,

- signatures cryptographiques,

- suivi du processus de rédaction dans le temps,

- conservation des brouillons et historiques de versions.

Pour les individus, la stratégie la plus efficace reste étonnamment simple : garder des traces du travail effectué, montrer l’évolution d’une idée, prouver la démarche intellectuelle.

Les enseignants et éditeurs expérimentés savent déjà reconnaître la cohérence argumentative, la réflexion personnelle et la maîtrise des sources — des éléments qu’aucun algorithme ne peut entièrement simuler.

Une leçon venue de 1776

Le cas de la Déclaration d’indépendance mal classée agit comme un signal d’alerte.

Si un outil ne peut pas distinguer un texte de 1776 d’un contenu généré en 2026, il serait imprudent de lui confier un pouvoir décisionnel absolu sur des étudiants, des journalistes ou des candidats à un emploi.

La technologie évoluera. Les attentes des lecteurs aussi.

Mais la confiance — elle — ne peut pas être réduite à un simple pourcentage.